di Beppe Grillo – L’Istat riporta che nel 2016 si sono verificati in Italia 175.791 incidenti stradali con lesioni a persone che hanno provocato 3.283 vittime e 249.175 feriti. Sono dati agghiaccianti e non va meglio altrove. Il dipartimento dei trasporti Usa ha stimato che solo nello scorso anno sono morti 35,000 persone solo negli States a causa di incidenti stradali.

Nel mondo ogni anno muoiono 1.2 milioni di persone a causa di incidenti causati dal traffico.

E se ci fosse un modo per ridurre del 90% questi incidenti non lo adottereste?

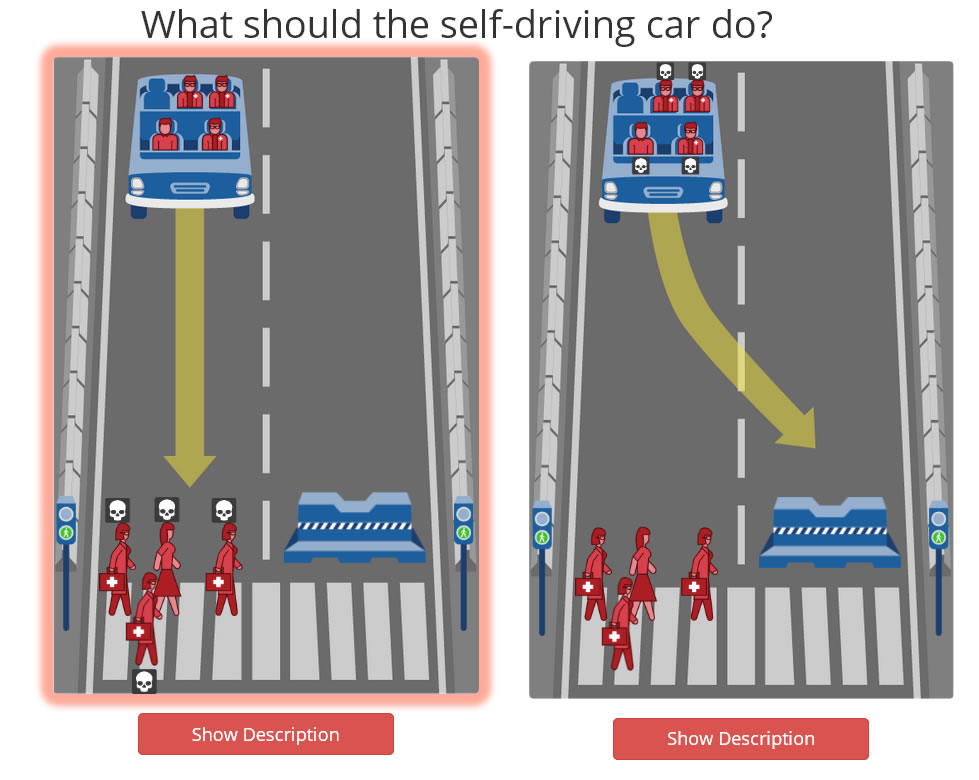

Questo è quello che promette la “Driveless Car Technology”, ossia la tecnologia auto senza guidatore. In pratica si propone di eliminare la principale fonte di questi incidenti: l’errore umano. Ora immaginiamo che ci sia un guasto meccanico che ci impedisca di fermare l’auto. Possiamo andare dritto o sterzare a sinistra o a destra. Andando dritto investiremo un gruppo di pedoni, sterzando a destra investiremo una donna incinta, sterzando a sinistra cadremo in un burrone.

Cosa dovrebbe fare la macchina?

Questo problema è ispirato al “problema del carrello ferroviario” enunciato da Philippa Ruth Foot nel 1967. In quel caso c’era un vagone di un treno che poteva solo cambiare rotaia. Nella prima c’erano 5 persone legate e nella seconda una sola. Ovviamente questo è uno scenario quasi irrealistico, molto difficilmente ci capiterà una situazione del genere. Fortunatamente nella grande maggioranza dei casi sterzando risolveremmo il problema. Ma il punto non è questo. Il punto è come immaginare il comportamento di una macchina.

Come programmare AI? L’intelligenza Artificiale come deve essere?

Il problema è etico. E’ Morale. E non è una questione cosi semplice. Prendiamo per esempio due padri fondatori della nostra etica. Bentham e Kant.

Bentham è il padre dell’utilitarismo. Quindi la macchina dovrebbe seguire questo principio, scegliendo di uccidere il minor numero di persone. Minimizzare il danno. Ma comprereste una macchina del genere? Probabilmente no. Perché nello scenario che ho descritto sopra, e quindi tra un gruppo di pedoni, una donna incinta e il burrone, una macchina dovrebbe scegliere voi. Kant ci dice che in nessun modo dovremmo compiere un’azione che volutamente sia fatta per recare danno ad una vita umana. Quindi dovremmo lasciare che la macchina vada per la sua strada, che si compia il destino, il caso.

Ma compreremmo una macchina che non siamo sicuri tuteli la nostra sicurezza? Probabilmente no. Cosa dobbiamo fare?

Le comunità si sono sempre organizzate intorno a istituzione, a loro volta costruite attorno a regole. Le regole funzionano perché la comunità le accetta, le sceglie, crede che siano vere, giuste. Le regole sono lo specchio dei valori sociali del nostro tempo.

Facciamo un esempio. Possiamo convivere prima di sposarci? Ovviamente si. Ma la risposta non sarebbe la stessa se rivolta a poche decadi fa. Per i nostri nonni e i nostri genitori sarebbe stato uno scandalo. Quindi le scelte che compiamo non sono tanto determinate da ciò che VOGLIAMO fare, ma ciò che POSSIAMO FARE.

Queste idee cambiano nel tempo, si modificano e si trasformano rendendo quello che era logico, totalmente illogico pochi anni dopo. Pensiamo alle nazioni. Quante culture con idee diverse, religioni diverse ci sono nel mondo? Semplicemente questo ci porta alla confusione. Il fatto è che noi pensiamo che la morale sia una cosa fissa, stabile, certa. Ma non è cosi.

Vi faccio un altro esempio: La macchina ha sempre un guasto meccanico e non è possibile fermarla. Questa volta ci sono solo 2 opzioni. Destra o Sinistra. A destra abbiamo 5 giovani di 20 anni. A sinistra una donna di mezza età.

La scelta sembrerebbe veramente facile. Ma basta che aggiungiamo un dato e la nostra morale cambia. Immaginiamo che io vi dica che la donna di mezza età è una ricercatrice che ha quasi scoperto la cura per una tipologia di cancro rarissima.

Probabilmente abbiamo cambiato idea, vero?

Il problema non è facile e in America degli studenti decidono di fare un sito: THE MORAL MACHINE WEBSITE. http://moralmachine.mit.edu/ Questo sito internet genera un nuovo scenario ogni volta che lo si visita dove chiede al visitatore di scegliere come deve comportarsi la macchina. Il sito propone anche vari tipi di vittima come animale, donne incinta, anziani, uomini, donne, etc. Il sito ha collezionato fino ad oggi più di 5 milioni di decisioni da più di un milione di visitatori. E’ un esperimento molto importante perché hanno partecipato persone da ogni parte del mondo, di differenti razze, età e culture.

E Come hanno risposto? Quali sono i più sacrificabili e i più salvati? Il soggetto più volte salvato è il CANE. E quello più volte ucciso è il BAMBINO.

Quindi ora vorreste conoscere da me una soluzione… Cosa posso dirvi? Se nel 2020 volete attraversare tranquilli, compratevi un cane.